Summary

π0.5: a Vision-Language-Action Model with Open-World Generalization

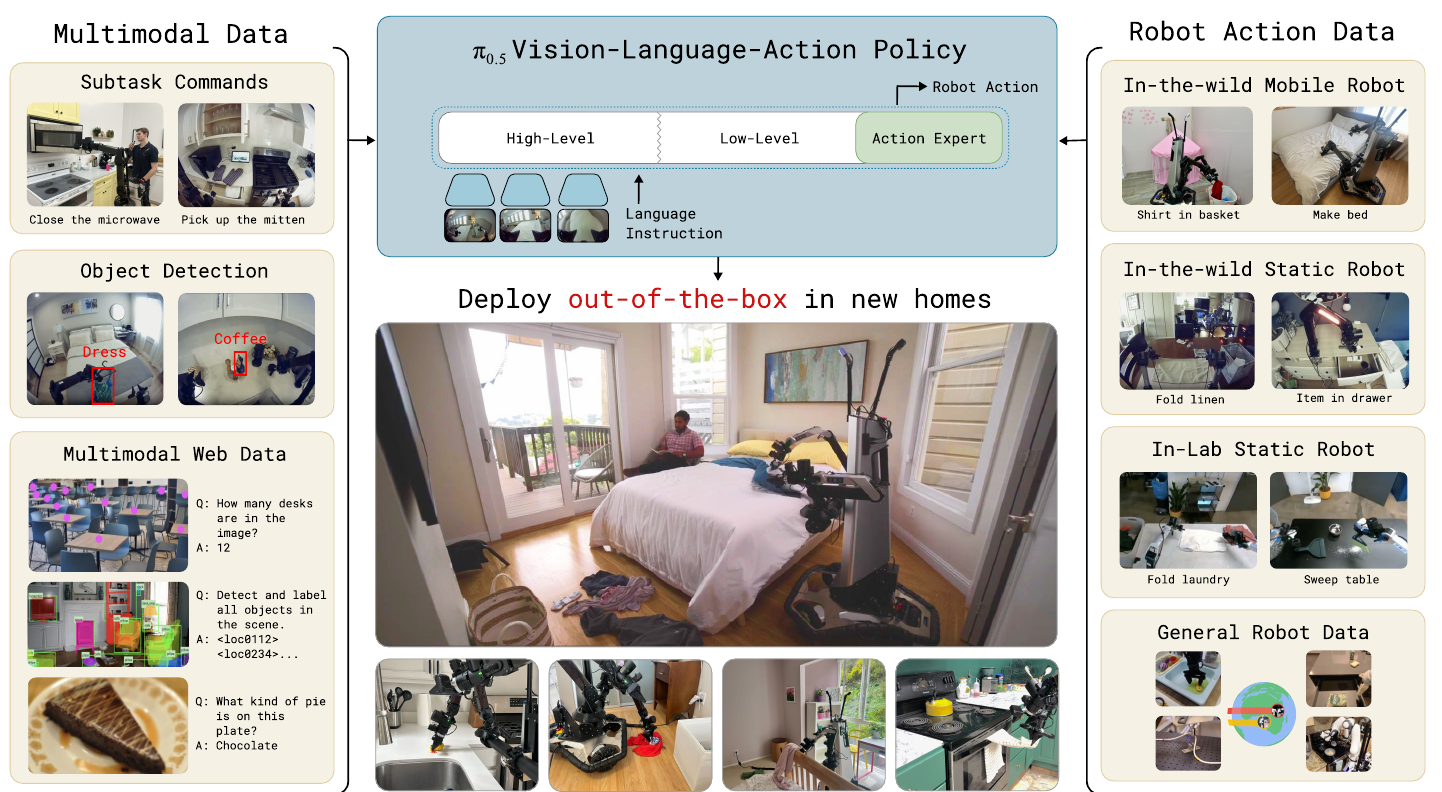

- 核心: 通过多源异构 co-training (MM/ME/CE/HL/WD/VI) + 两阶段 discrete→continuous action head,π0.5 在未见过的真实家庭里完成长时程灵巧操作。

- 方法: PaliGemma 风格 VLA backbone + FAST 离散 action token(pre-training)+ flow matching action expert(post-training)+ 显式高层子任务预测。

- 结果: 在 mock home 和真实 Airbnb 民宅上全面超越 π0 和 π0-FAST+Flow;数据消融显示跨 embodiment 数据对成功率最关键,web data 主要帮助 OOD 语言跟随。

- Sources: paper | website | github

- Rating: 3 - Foundation(2026-04 升档:citation=744 / velocity=61.49/mo、influential 比例 15.7%、openpi 11.5k⭐ 活跃维护,异构 co-training recipe 与 hybrid action head 已成为后续 open-world VLA 的必引奠基)

Key Takeaways:

- Heterogeneous co-training is the main lever: 单靠机器人数据不足以支撑 open-world 泛化。pre-training 阶段 97.6% 的样本来自非目标移动平台(其它机器人 / web data / HL 标注),而最终 deployment 在全新家庭里仍能跑通长时程任务,证明 transfer 比”同分布堆数据”更划算。

- Hybrid discrete + continuous action head: 同一个 VLM backbone 既输出 FAST 离散 action token(pre-training 友好,可与 language / subtask token 同 loss 训练),又接 flow matching action expert(inference 时高频灵巧控制);attention mask 阻断两路的相互干扰。

- High-level subtask prediction 是桥梁: 模型在 inference 时先预测自然语言子任务 (如 “pick up the plate”),再以它为条件输出低层动作。这一显式中间层既让训练能吸收人类语言标注,也让 long-horizon 任务可分解;同一个模型同时做高层和低层(更接近 chain-of-thought 而非两个分离模型)。

- 泛化 scaling: generalization 随训练场景数量平滑提升;从 ~100 个环境起,模型在全新家庭达到接近 “训练分布内” baseline 的成功率。

- 实证清单:整厨房清理、卧室清理等 10–15 分钟级别长时程任务在全新、未见过的 Airbnb 民宅中完整执行,是当前 end-to-end VLA 在真实家庭泛化上报告到的最强结果。

Figure 1. π0.5 overview. π0.5 通过异构数据 co-training 把知识从其他机器人、high-level subtask 预测、口头指令以及 web data 迁移过来,在训练里没出现过的家庭中开箱即用地完成 10–15 分钟级别的多阶段任务(厨房 / 卧室清理)。

Teaser Video. π0.5 overview — long-horizon autonomous manipulation in unseen homes. 项目主页置顶视频,展示 π0.5 在多个未见过家庭中完成厨房 / 卧室清理的代表性 episode。

Introduction

Open-world generalization 是 embodied AI 最核心的未解问题:机器人只有离开实验室、能够处理真实世界的 long-tail 才算真正有用。π0.5 的立场是——单纯 scale 同源机器人数据不够,必须引入多层次异构数据 co-training:直接相关的同平台操作数据、不同 embodiment 的迁移数据、以及完全不同模态的语言和视觉任务数据。这样模型才能在语义(该打开哪个抽屉)、物理(没见过的形状如何抓)、时序(长任务如何分解)三个层次同时泛化。

❓ 一个核心隐含假设是 “VLA 这种统一序列模型能把异构数据有效融合”——如果某类数据的 loss landscape 与机器人动作 loss 有 destructive interference,简单加权混合不一定 work。论文用经验性 ablation 给了支持,但缺少机制层面的解释。

Figure 2. π0.5 cleaning a new kitchen. 图中机器人执行的指令是 “close the cabinets, put the items in the drawer, wipe the spill, and put the dishes in the sink”——high-level 指令交给同一个模型,模型自己分解为 “pick up the plate” 等子任务,再发出低层关节命令。

Preliminaries

论文把 VLA 建模成一个统一的条件序列模型:给定观测 和任务指令 ,目标是输出动作块 。作者把 π0 的 flow matching action head 保留下来作为低层控制器,但在 pre-training 阶段把低层动作统一 tokenize(借 FAST 离散化),从而让动作和语言 / subtask / 图像这些异构 token 共享同一个 transformer 的训练目标。这为下一章的 hybrid head 铺路。

The π0.5 Model and Training Recipe

Figure 3. Model overview. π0.5 分两阶段训练:(i) pre-training 阶段把所有数据源(多机器人动作、HL 子任务预测、WD)统一到 next-token prediction,动作走 FAST 离散 token;(ii) post-training 阶段加一个独立的 flow matching action expert,负责高频实时连续控制;inference 时先预测高层子任务,再条件化生成低层动作。

Architecture

模型在推理时把联合分布分解为一个高层语言子任务预测和一个低层动作预测:

符号说明: 当前观测(多路 RGB + proprioceptive state), 人类给的高层指令, 模型自己预测的自然语言子任务(如 “pick up the plate”), 长度为 的动作 chunk。 含义:模型先把大任务切成可执行的语言子任务,再把子任务作为短时条件化信号生成低层动作,本质上是一个显式的 hierarchical policy;关键在于两个分布由同一个transformer 用不同 expert 权重输出。

骨干基于 PaliGemma 2B VLM(width=2048, depth=18, 18 heads, head_dim=256),action expert 是 300M 参数的小 transformer(width=1024, mlp=4096)。Image patches、prompt tokens、proprio state 之间走 full prefix mask;FAST action token 走 causal mask;flow matching action token 之间双向 attend prefix 与彼此,但不回头 attend FAST token——避免两套动作表示互相泄露信息。

Combining discrete & continuous action representations

Pre-training 和 inference 对动作表示的要求是冲突的:pre-training 想把动作和其他 token 一起做 autoregressive next-token loss(因此要离散),但 inference 想要高频连续控制(因此要 flow matching)。π0.5 的解法是同一个 VLA backbone 接两个 action head:一个 FAST 离散 head 吃 cross-entropy loss,一个 flow matching head 吃 velocity-field 回归 loss,二者 loss 相加:

符号说明: cross-entropy(其覆盖文本与 FAST action token), 输出离散 token logits, 是 flow matching velocity 网络, 是带噪动作 chunk, 是两个 loss 之间的权重。 含义:Pre-training 时 ,模型纯做 next-token prediction(包含 FAST tokenized 动作);post-training 时 ,flow matching head 才被激活并学到细粒度连续动作。Inference 时高层子任务走 autoregressive decoding,低层动作走 10 步 flow matching denoising,从而兼顾”训练效率”和”实时控制”。

Pre-training: heterogeneous data mixture

Pre-training 混合了五类数据源(约 280k gradient steps):

- MM (Mobile Manipulators, ~400 hours):自家移动双臂机器人在约 100 个不同家庭里采集的同平台数据。这是与最终评估任务最相关的切片。

- ME (Multi-Environment non-mobile):非移动机器人(单臂或双臂、固定底座)在多种家庭环境中采集的数据。轻便平台让数据集环境覆盖更广。

- CE (Cross-Embodiment, lab):实验室桌面环境下的多 embodiment 数据(含 OXE / Open X-Embodiment 公开集),任务跨度大(从擦桌子到磨咖啡豆),体现”任务多样性”维度。

- HL (High-Level subtask prediction):对 MM/ME/CE 的多阶段任务做人工子任务标注(“adjust the blanket”、“pick up pillow”),训练模型在 observation+高层指令条件下预测自然语言 subtask + bounding box。

- WD (Multi-modal Web Data):image captioning(CapsFusion、COCO)、QA(Cambrian-7M、PixMo、VQAv2)、object localization(含自采室内场景标注)。

所有动作都过 FAST tokenizer 离散化;不同机器人的动作维度补零到统一长度,并按 1%/99% 分位归一到 。Control mode(joint vs end-effector)通过 prompt tag 区分。

❓ 一个值得注意的事实:pre-training 阶段 97.6% 的样本不是来自最终目标的 mobile manipulator——这意味着模型几乎从其他来源”借”知识。这个比例本身在论文里被强调,但没有 ablation 分析”如果反过来 MM 占大比例会怎样”。

Figure 4. Examples from pre-training and post-training tasks. 横轴是数据类别(MM / ME / CE / HL / WD / VI),每列展示一个该类下的代表性训练样例。Pre-training 用前五类,post-training 加入 VI 并移除 lab CE。

Video. Robot action data — In-the-wild Mobile Robot. Co-training 中 mobile manipulator 数据切片的样例片段。

Video. Robot action data — In-the-wild Static Robot (ME). 非移动机器人在多样家庭环境中的数据采集片段,对应 ME 切片。

Post-training: specialize for mobile manipulation

Post-training 阶段(80k 额外步)切换到部署相关的数据切片:

- 保留 MM + 多环境 HL + WD(保留语义 / 视觉能力)。

- 去掉 lab CE(它的 embodiment 与目标平台差异最大,post-training 阶段收益递减)。

- 新增 VI (Verbal Instructions):人类专家通过自然语言指令实时”遥操作”机器人——选择合适的子任务命令一步步指导机器人完成移动操作任务。这本质上是给训练数据提供”高质量的高层 policy 输出”示例。

- ,让 flow matching action expert(随机初始化)从头收敛。

❓ VI 数据的来源很特别:它不是真人遥操机器人的关节,而是真人用语言”教”机器人——某种意义上是用人类的判断给 high-level head 蒸馏。这个范式有 RLHF 的味道,但作者没把它放到这个框架里讨论。

Robot system

Figure 5. Robot system overview. 两类 mobile manipulator 平台:每个有四路相机(前 / 后 / 双手腕),两个 6-DoF 双臂 + parallel jaw gripper、holonomic 轮式底盘、可升降躯干(1D 或 2D)。π0.5 直接发关节角与底盘速度(50 Hz, action chunking),由简单 PD 控制器跟踪——没有轨迹规划或碰撞检测,全 end-to-end。

Experimental Evaluation

Figure 6. Evaluation environments. 全部评估都在训练未见过的环境里完成:左侧 mock kitchens / bedrooms 用于可控的定量比较,右侧 real Airbnb 民宅用于最终现实评估,物体 / 背景 / 布局都未在训练数据中。

实验回答五个问题:(1) 能否在全新真实家庭做长时程任务?(2) 泛化随场景数如何 scale?(3) co-training 各成分的贡献?(4) 与 π0 / π0-FAST+Flow 比较?(5) 显式 high-level inference 必要吗?

Q1: Generalization to real homes

在三栋未见过的 Airbnb 民宅里跑两类家务(厨房与卧室清理),任务多为 2–5 分钟级别的 multi-stage(如 “把所有餐具放进水槽” “把脏衣服放进洗衣篮”)。给的指令是简短高层提示,机器人自己分解 subtask 并执行。

Figure 7. Real-home rollouts and quantitative evaluation. 三栋未见家庭中的代表性 rollout 截图(Home 1: 物品入抽屉;Home 2: 餐具入水槽;Home 3: 衣物入篮)以及对应的成功率柱状图。每帧下方蓝色文字是模型自己预测的 subtask。

Video. Fully autonomous long-horizon bedroom cleanup in an unseen home. 完整 5×加速回放,从无人干预地清理床铺、整理物品到结束。

Video. Long-horizon kitchen cleaning in an unseen home (10×). 包含分散物品归位、餐具入水槽、清扫 spill 等多阶段子任务,10×加速。

Q2: How does generalization scale with the number of scenes?

作者按 3 / 12 / 22 / 53 / 82 / 104 个训练家庭分别 post-train,所有模型 step 数相同(控制 dataset size)。

Figure 8. Performance vs. number of training locations. 四个测试任务(“dishes in sink”、“items in drawer”、“laundry basket”、“make bed”)的平均成功率随训练环境数稳步上升;绿色虚线是把测试家庭直接放进训练集的 in-distribution 上界,最终 104-环境的 π0.5 几乎追平这一上界——即使它从没见过测试家庭。浅色对照(不带 co-training recipe 的版本)的低水平表明 co-training 是关键。

Figure 9. Language following vs. number of training locations. 区分 in-distribution 物体(同类别新实例)和 out-of-distribution 物体(未见类别)。两条曲线都随场景数提升,OOD 提升较慢但持续——说明每个新环境也带入新物体,扩展了模型的 visual concept 覆盖。

Q3: Importance of each co-training ingredient

逐个移除 pre-training 数据源做 ablation。结论是 cross-embodiment 类数据(ME + CE)对总体成功率至关重要;web data (WD) 的收益主要体现在 out-of-distribution 语言跟随上。

Figure 10. Training recipe ablations on mock homes. 在四个测试任务上对各 ablation(no WD / no ME / no CE / no ME or CE)做 10 trials/policy 评估。去掉 ME 或 CE 都显著掉点,去掉两者更糟;no WD 在 mock home 端到端任务上影响不显著。

Figure 11. Training recipe ablations, language following. 把 ablation 拆到 in-distribution / OOD 物体两侧后,no WD 的性能在 OOD 上明显下降——web data 给了模型关于”未见过的物体”的语义先验。CE / ME 在两侧都重要。

❓ Figure 10 与 11 一起读才有意义:单看 Figure 10,会以为 WD 用处不大;只有把语言跟随 OOD 单独切片才能看到 WD 的真正价值。这暗示通过端到端任务成功率衡量 WD 贡献是不充分的——后续工作如果想验证 web data 收益应该多用 finer-grained metric。

Q4: Comparison to other VLAs

在相同 mock-home 设置下对比 π0.5、π0、π0-FAST+Flow。π0-FAST+Flow 是给 π0 加上 hybrid discrete/continuous head、训同等步数后的强 baseline,但没有 HL/WD 数据;这个对比把 architecture 收益和 co-training 收益剥离开。

Figure 12. Comparing π0.5 with other models. 完整 π0.5 在 mock home 测试里显著领先 π0 和 π0-FAST+Flow,即使 π0 训到 300k 步也追不上。结合 π0-FAST+Flow vs π0 的差距相对 π0.5 vs π0-FAST+Flow 更小,说明co-training 数据混合是性能提升的主要来源,而不是 hybrid action head。

Q5: Importance of high-level inference

最后一个问题:推理时显式先预测 再条件化低层动作(“explicit HL”)是否必要?作者对比七种设定:

- 完整 π0.5(同模型做 HL+LL)

- no WD:去掉 web data

- no VI:去掉 verbal instruction 数据

- implicit HL:训练时有 HL 数据,但 inference 时不显式跑 HL,直接把原 prompt 给低层

- no HL:连 HL 数据都不放进训练

- GPT-4 HL:用 GPT-4 当高层 policy(zero-shot prompt)

- human HL:人当 oracle 高层

Figure 13. Evaluation of the high-level inference process. 完整 π0.5 最强,甚至超过 human HL oracle。implicit HL(同模型,但 inference 不显式跑高层)次之——说明HL 数据本身的训练效益就很大,即使 inference 时不显式调用。no HL 大幅下降;no VI 也明显掉点(VI 数据虽只占 mobile-manipulation HL 样本的 ~11%,但贡献不可替代);no WD 在这里显著下降——说明 web data 的主要价值在 high-level policy;zero-shot GPT-4 HL 表现最差,证明纯靠 LLM 先验不够,需要 in-domain 适配。

❓ “implicit HL 次之” 是个反直觉但很有用的发现:它意味着 HL 数据更多是在改 representation 而不是 inference-time pipeline。如果这是真的,那 chain-of-thought-for-action 的关键并不是 inference 时多步 reasoning,而是训练目标里多了一种结构化标注。值得追究的开放问题。

Reactivity & language following

Video. Robust to human perturbation during dish-in-sink. 实验员在执行过程中故意扰动机器人和场景,π0.5 仍能 recover。

Video. Language following — fine-grained command (pick up the funnel). OOD object 类别的语言跟随测试。漏斗未在训练数据中出现,π0.5 仍能从五件物体里找到正确目标并放入抽屉。

Implementation details

| 组件 | 设置 |

|---|---|

| VLM backbone | PaliGemma 2B(width=2048, depth=18, 18 heads, head_dim=256) |

| Action expert | 300M params(width=1024, mlp=4096),与 VLM 同 depth/heads |

| Action chunk horizon | (50 步),50 Hz 控制 |

| Pre-training steps | 280k |

| Post-training steps | 80k,loss 权重 |

| Flow matching schedule | 训练 ,;推理 10 步去噪 |

| Image augmentation | RandomCrop(0.95)、Resize、Rotate(±5°)、ColorJitter(b=0.3, c=0.4, s=0.5) |

| Timestep injection | 单独 MLP 编码 → adaptive RMSNorm 注入 action expert 每层 |

OpenPI repo (Physical-Intelligence/openpi) 提供 base checkpoint pi05_base、LIBERO benchmark 上 SOTA 的 pi05_libero、以及在 DROID-style 数据上做”知识隔离 (knowledge insulation)“微调的 pi05_droid;2025-09 起补齐 PyTorch 推理 / 微调路径(先前以 JAX 为主)。

关联工作

基于

- π0:π0.5 的直接前身,共享 PaliGemma + flow matching action expert 的主体结构,π0.5 的增量是 co-training 数据混合和 hybrid discrete/continuous head。

- FAST action tokenizer:把连续动作离散化为 token,使 pre-training 能和语言 / subtask 共享 autoregressive loss。π0.5 用它承担 pre-training 阶段的动作表示。

- PaliGemma 2B:VLM backbone(width=2048, depth=18),把视觉与语言能力初始化好。

对比

- π0:同实验室前作,作为 Q4 的主要 baseline;π0.5 在 mock home 上全面领先,说明异构 co-training 的增量。

- π0-FAST+Flow:π0 的 hybrid 改进版本(同样的 discrete+continuous head,但只训练 robot action 数据,不带 HL/WD),用来把 architecture 收益和数据收益剥离。

- OpenVLA / OpenVLA-OFT:相关工作中的主流开源 VLA baseline 之一。

- Octo:早期跨 embodiment generalist policy,作为 cross-embodiment 数据驱动 policy 的先驱。

- RT-2:VLA 范式的奠基工作,PaLM-E 之后第一波”web 知识 → action”的代表。

方法相关

- Flow Matching:低层动作表示的生成目标,π0 首次引入到 VLA,π0.5 保留并与离散 action token 并用。

- Hierarchical high-level planning:通过显式预测自然语言子任务分解长时程任务。和 Hi Robot 设计哲学相近——后者是 VLM planner + VLA executor 的双模型方案,π0.5 把两者收进同一个网络。

- Cross-embodiment training:把跨平台机器人数据放进单一 policy 来换泛化(OXE / RT-X 范式)。π0.5 的 CE 部分本质是同一思路。

- Knowledge insulation(openpi README 提到,对应

pi05_droid微调路径):在保留 base 模型语义先验的前提下做下游适配的技术线。

后续

- π0.7:同实验室继任者,进一步把 generalist + steerable 推到新的 frontier。

论文点评

Strengths

- 问题定义直击痛点:open-world 家庭部署是 VLA 方向最能把 paper 和 product 拉齐的问题设定,而且”在 Airbnb 民宅里自主清理卧室”这种 demo 的信息量远高于实验室 benchmark。

- Co-training 的 ablation 非常系统:不是模糊地说”异构数据有用”,而是给出 MM / ME / CE / HL / WD / VI 六类数据各自的贡献 breakdown,移除任一类的代价都可以读出来,方便别人复用该训练食谱。

- Hybrid discrete + continuous head 是干净的工程方案:把 “pre-training 想要离散 token、inference 想要高频连续” 这个老矛盾用两阶段 调度 + 共享 backbone 解决,而不是训两个模型或者两阶段蒸馏。

- Implicit HL 的反直觉发现:HL 数据在训练里就已经”用完了”——inference 时是否显式分两步差距不大。这个观察改变了大家对”先 reason 再 act”的直觉。

- 开源覆盖完整:

Physical-Intelligence/openpi同时支持 inference 和 training,base + LIBERO + DROID 三个 checkpoint 都对外发布,这在 frontier VLA 里非常少见。

Weaknesses

- 绝对成功率不公开透明:正文几乎全部以 bar chart 呈现结果,主表级数字没有汇总成 table,第三方再现性评估需要先肉眼读图。

- “新家庭”的分布偏移量未量化:作者强调测试在未见 Airbnb 民宅,但没有刻画训练和测试环境分布的差异(光照、相机视角、家具 class 分布),所以”泛化到新家庭”的难度无法和其他工作横向比较。

- Web data 在端到端任务上影响有限:Figure 10 在 mock home 端到端任务上 no WD 与 full 不显著;正文措辞偏向”WD 很重要”,实际是”WD 主要在语言 grounding 和高层 policy 上有增量”。

- VI 数据细节披露不足:post-training 新增的 verbal instruction 数据缺少组成、规模和采集协议描述;既然它是 high-level policy 的关键监督源,这块的公开度应该更高。

- Long-horizon 失败模式分析不足:视频里能看到失败 case(放错位置、漏物、HL 来回 toggle),但 paper 没做失败模式分类或 root-cause 分析;对设计下一代系统而言这恰恰是最有信息量的部分。

- 训练计算量未披露:280k pre-training + 80k post-training 的硬件、wall-clock、数据 token 数等都没给,让”co-training 是否高效”无法横向比较。

可信评估

Artifact 可获取性

- 代码: inference + training 都开源(

Physical-Intelligence/openpi,JAX 为主,2025 年 9 月补齐 PyTorch 推理 / 微调)。 - 模型权重: 已发布

pi05_base(基础 fine-tuning 起点)、pi05_libero(LIBERO benchmark,SOTA)、pi05_droid(DROID 数据微调,快速推理 + 良好语言跟随);同 repo 还附带pi0_base/pi0_fast_base及若干 ALOHA / DROID fine-tuned checkpoint。 - 训练细节: 仅高层描述。给出了 co-training 数据类别(MM/ME/CE/HL/WD/VI)、两阶段 调度概念、以及部分超参(depth/width、、image aug、timestep schedule);完整的 dataset mixture 比例、训练步数 vs 数据量配比、计算预算未系统披露。openpi repo 的 training configs 里能读到部分 hyperparameter。

- 数据集: 部分公开。主要为 Physical Intelligence 内部采集的 mobile manipulator 数据(私有);公开组件包括 OXE、DROID、LIBERO 以及 web data 的标准数据集(CapsFusion、COCO、Cambrian-7M、PixMo、VQAv2)。完整的 co-training mixture 没有作为单一 release 对外发布。

Claim 可验证性

- ✅ “能在未训练过的真实家庭完成长时程任务”:project page 有多段完整 rollout 视频,包括 Airbnb 民宅的 fully-autonomous 卧室清理(见 Q1 嵌入的 video);权重开源,理论上可复现。

- ✅ “移除异构数据会显著掉点”:Q3 的 ablation 给了逐项对比,实验设置清楚,trial 数(10/policy)明确。

- ✅ “implicit HL 仍能利用 HL 数据”:Q5 的 Figure 13 直接给出对比,结论 robust。

- ⚠️ “泛化随场景数平滑 scale”:Figure 8/9 的 x 轴只有 6 个点,低数据区间的不确定性可能被平滑掉;作为 scaling 趋势参考可以,作为 scaling law 还不够严格。

- ⚠️ “首次端到端 VLA 能在新家庭完成长时程灵巧操作”:这个 “first” claim 受限于同期工作的定义边界(带 high-level planner 的系统是否算 end-to-end?数据采集时是否完全没接触过测试场景的”分布”?),需要把 “end-to-end” 与 “unseen home” 的范围讲清楚才能严格判断。

- ⚠️ “Web data 对 OOD 泛化很关键”:仅在 OOD 语言跟随这一切面上成立,正文表述(在端到端任务上下文里)比 ablation 能支持的结论更强。

- ⚠️ “完整 π0.5 超过 human HL oracle”:人类 HL 不是真正的 oracle,而是凭经验给指令的人;如果换更熟悉机器人能力的标注者,oracle 上限应该更高。这个对比的”超过 human”措辞容易误读。

Notes

- Co-training data 比例的 Pareto 问题:论文给了”移除任一类会掉多少”,但没给”加 5×WD 会怎样”。下一代该研究的是 mixture 的 Pareto frontier,而不是单点配方。

- Implicit HL 的发现可能比 explicit HL 更重要:如果 HL 数据的价值主要在 representation 而不是 inference-time pipeline,那很多”chain-of-thought-for-action”工作的 inference-time 复杂度可以省掉——这是个值得验证的 follow-up。

- VI 数据像 RLHF for high-level policy:人类口头指导 = 高层 policy 的 high-quality rollout 标签。这个范式可以推广到 LLM agent 的 high-level reasoning 训练——值得跨域看看有没有现成工作。

- Open question — failure cascade:高层子任务 预测失败时 low-level policy 的 recovery 能力如何?video 里有些失败看起来是 HL 错了 → LL 跟着错。是否需要 LL 对 HL 的 self-consistency 检查?

- 下一步值得读:(1)

knowledge insulation的论文(openpi README 引用),看它如何在保留 backbone 知识的同时做下游适配;(2) π0.7 看 PI 在 π0.5 之后的方向变化。

Rating

Metrics (as of 2026-04-24): citation=744, influential=117 (15.7%), velocity=61.49/mo; HF upvotes=4; github 11498⭐ / forks=1828 / 90d commits=22 / pushed 8d ago

分数:3 - Foundation 理由:初评为 2 - Frontier 时理由是”方向必比 baseline 但尚未成 de facto 标准”。2026-04 复核升档:12.1 个月后 citation=744 / velocity=61.49/mo(VLA 方向内顶级、与 GR00T N1 同档)、influential 比例 15.7%(远高于典型 10%,按 rubric 属”技术被实质继承”)、openpi 仓库 11498⭐ / 1828 forks / 22 commits in 90d / pushed 8d 是当前 open VLA 生态最活跃、最常被 fork 的 codebase 之一——这些指标都已超出”前沿参考”而进入”方向必读”量级。异构 co-training recipe(MM/ME/CE/HL/WD/VI 六类数据 ablation)和 hybrid discrete+continuous action head 已被后续 open-world VLA 工作普遍采纳为 recipe 起点,和 GR00T N1 一起构成 2025 年 open-world VLA 的两大 Foundation 参考,故评 3。